Il panorama dei modelli di linguaggio sta vivendo una significativa evoluzione grazie al recente lancio del modello DeepSeek-V3-0324, sviluppato da una startup cinese. Questo nuovo modello, rilasciato in modalità open source, è progettato per funzionare senza problemi su dispositivi come il Mac Studio di Apple, con prestazioni che superano i 20 token al secondo. Questa innovazione sfida le convenzioni tradizionali che richiedevano l’uso di grandi centri dati per l’elaborazione.

caratteristiche tecniche di DeepSeek-V3-0324

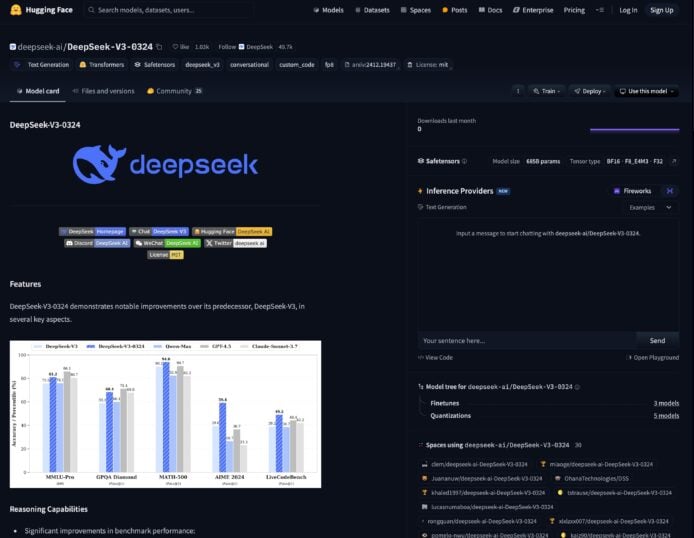

Il modello DeepSeek-V3-0324, caricato su Hugging Face il 24 marzo, vanta un peso complessivo di 641GB, ma non è accompagnato da documentazione tecnica dettagliata. La scelta del team di sviluppo cinese di adottare un approccio discreto contrasta con le strategie promozionali più elaborate delle aziende occidentali.

architettura avanzata

Con un totale di 685 miliardi di parametri, questo modello si colloca tra i più grandi attualmente disponibili e utilizza un’architettura chiamata Mixture-of-Experts (MoE). Questa struttura consente al sistema di attivare solo i parametri necessari per ciascun compito specifico, riducendo notevolmente le esigenze computazionali e aumentando l’efficienza.

innovazioni tecnologiche integrate

DeepSeek-V3-0324 introduce due innovazioni chiave: la Multi-Head Latent Attention (MLA) e la Multi-Token Prediction (MTP). Queste tecnologie migliorano la capacità del modello nel gestire testi lunghi e aumentano la velocità della generazione dei token fino all’80% rispetto ai metodi tradizionali.

prestazioni su hardware consumer

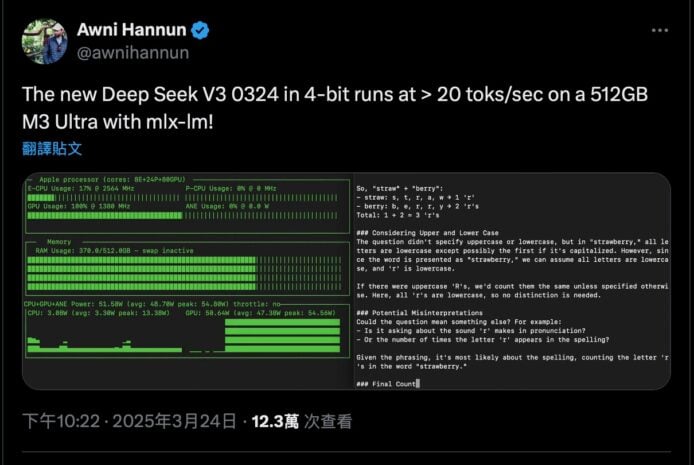

I test effettuati su un Mac Studio dotato di chip M3 Ultra hanno dimostrato che una versione semplificata a 4 bit può generare oltre 20 token al secondo. Ciò rende possibile l’esecuzione di modelli avanzati anche su dispositivi consumer standard, senza necessità di configurazioni hardware costose.

implicazioni per il mercato dell’AI

I risultati ottenuti dal DeepSeek-V3-0324 nei test interni indicano un netto miglioramento rispetto alle versioni precedenti e alla concorrenza attuale, come Claude Sonnet 3.5. A differenza di quest’ultimo, DeepSeek offre modelli gratuiti e utilizzabili commercialmente, abbattendo le barriere d’ingresso nel settore dell’intelligenza artificiale.

- DeepSeek-V3-0324

- M1 Ultra Chip

- M3 Ultra Chip

- Claude Sonnet 3.5

- Mixture-of-Experts (MoE)

- Multi-Head Latent Attention (MLA)

- Multi-Token Prediction (MTP)

L’emergere della tecnologia DeepSeek segna un cambiamento significativo nelle modalità operative dei modelli AI e potrebbe incentivare sviluppatori ed aziende a considerare soluzioni open source piuttosto che piattaforme a pagamento dominanti sul mercato.

Lascia un commento